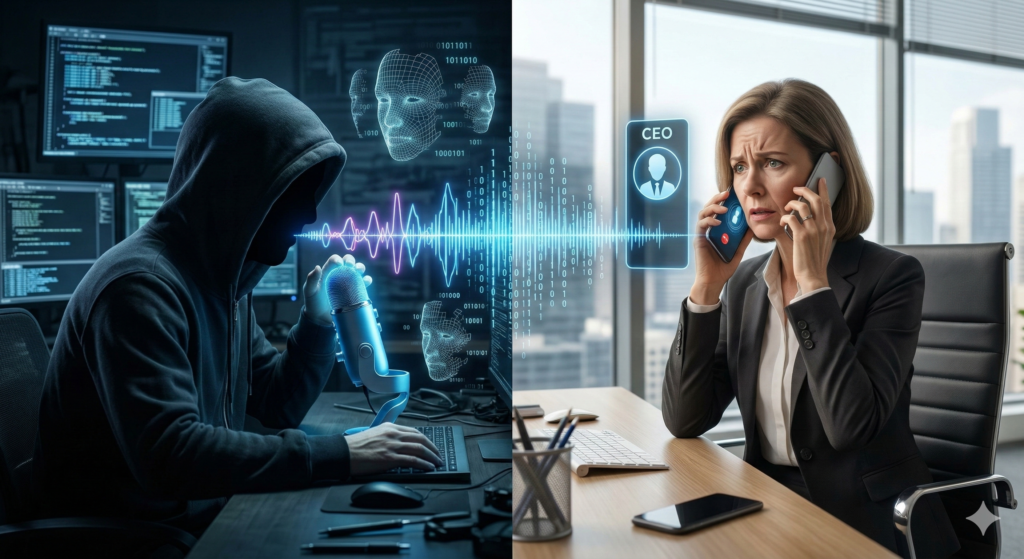

Odbierasz pilny telefon. Głos w słuchawce brzmi w stu procentach jak Twój wspólnik lub prezes, który z powodu „nagłej awarii” żąda natychmiastowego zatwierdzenia przelewu na nowe konto dostawcy. Wykonujesz polecenie, a kilka godzin później odkrywasz, że właśnie wytransferowałeś firmowy kapitał na rachunek hakera. Deepfake 2.0 w atakach socjotechnicznych sprawia, że weryfikacja tożsamości „na słuch” lub „na oko” stała się bezużyteczna. Czas wdrożyć inżynierskie bezpieczeństwo AI, zanim algorytmy zrujnują płynność finansową Twojej firmy.

Analiza zagrożenia: Dlaczego weryfikacja tożsamości przestała działać?

Jeszcze niedawno ataki typu oszustwo na prezesa (Business Email Compromise – BEC) opierały się na fałszywych wiadomościach e-mail. Wymagały od przestępcy przejęcia skrzynki pocztowej lub stworzenia łudząco podobnej domeny. Dzisiaj, dzięki rozwojowi generatywnej sztucznej inteligencji, wkraczamy w erę Business Voice Compromise (BVC). To zupełnie nowy, destrukcyjny wektor ataku uderzający bezpośrednio w polskie MŚP.

Klonowanie głosu AI nie wymaga już godzin nagrań w profesjonalnym studiu. Hakerowi wystarczy zaledwie 3-sekundowa próbka audio, pobrana z firmowego webinaru, wywiadu na YouTube czy nawet z prywatnego profilu na Instagramie. Na podstawie tego krótkiego fragmentu, nowoczesne modele LLM potrafią w czasie rzeczywistym generować płynną mowę, zachowując unikalną barwę, intonację, a nawet akcent Twojego dyrektora finansowego.

Ból biznesowy: Iluzja bezpieczeństwa w MŚP

Największym problemem nie jest sama technologia, lecz ludzka psychika i przestarzałe nawyki. Jesteśmy ewolucyjnie zaprogramowani, by ufać temu, co słyszymy i widzimy. Kiedy pracownik działu księgowości odbiera telefon (często ze sfałszowanym numerem Caller ID, co uwiarygadnia atak), a w słuchawce słyszy zdenerwowanego szefa, włącza się tryb paniki i posłuszeństwa.

Skutki braku procedur weryfikacyjnych są natychmiastowe i brutalne:

- Bezpowrotna utrata kapitału: Środki wyprowadzone w ten sposób są niemal niemożliwe do odzyskania, ponieważ przelew został autoryzowany przez legalnego pracownika z odpowiednimi uprawnieniami.

- Ryzyko kar RODO: Jeśli ataki socjotechniczne posłużą do wyłudzenia haseł dostępowych do bazy CRM, mamy do czynienia z potężnym wyciekiem danych.

- Utrata zaufania B2B: Klienci i partnerzy biznesowi nie wybaczą Ci utraty ich poufnych informacji w wyniku „nabrania się na sztuczną inteligencję”.

Inżynierskie rozwiązanie krok po kroku: Jak zablokować Deepfake 2.0?

Z perspektywy inżynierii cyberbezpieczeństwa, walka ze sztuczną inteligencją przy pomocy intuicji z góry skazana jest na porażkę. Twoja firma potrzebuje mechanizmów, które całkowicie eliminują czynnik ludzkiej łatwowierności. Musisz zbudować system oparty na twardej matematyce i żelaznych procedurach operacyjnych.

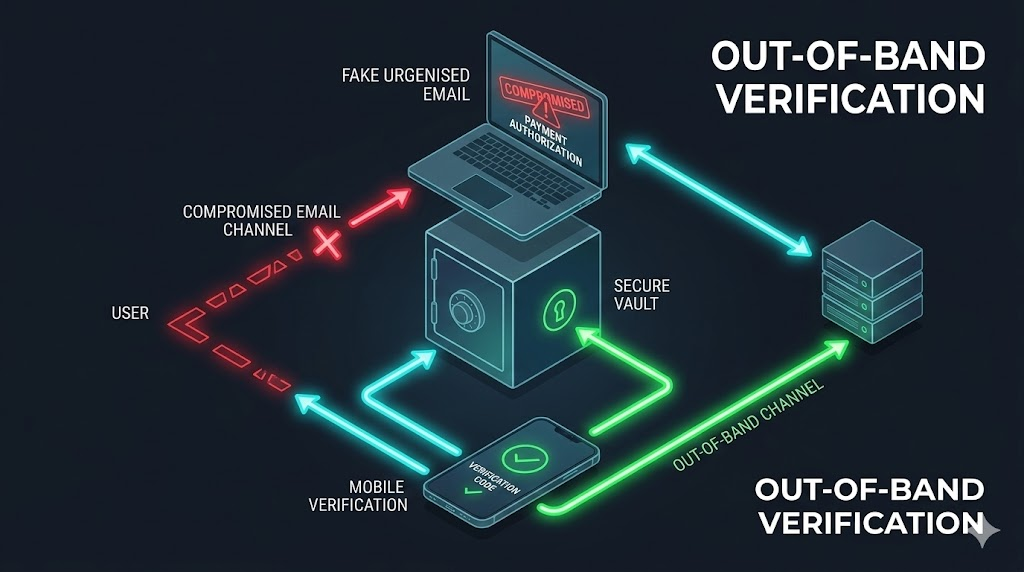

Krok 1: Architektura Zero Trust i weryfikacja Out-of-Band

Zasada Zero Trust (Ograniczone Zaufanie) oznacza, że system (i pracownik) nie ufa żadnemu żądaniu, dopóki nie zostanie ono kryptograficznie lub proceduralnie potwierdzone. W przypadku poleceń finansowych należy wdrożyć weryfikację „Out-of-Band” (poza pasmem). Jeśli dyspozycja przychodzi mailem, potwierdzasz ją telefonicznie. Jeśli przychodzi telefonicznie – potwierdzasz ją w wewnętrznym, szyfrowanym komunikatorze firmowym (np. Slack/Teams), pisząc bezpośrednio do zainteresowanego.

Krok 2: Wdrożenie haseł bezpieczeństwa (Safewords)

To najtańsza i najbardziej skuteczna polityka bezpieczeństwa AI w małej firmie. Zarząd oraz osoby dysponujące kapitałem muszą ustalić tajne „hasło bezpieczeństwa” (np. absurdalne słowo lub konkretną frazę). Jeśli dyrektor dzwoni z prośbą o pilny przelew omijający standardowe procedury, pracownik ma obowiązek zapytać o hasło. Żaden model AI klonujący głos nie będzie w stanie odgadnąć tego zabezpieczenia z offu.

Krok 3: Procedura Kill-Switch i izolacja incydentu

Gdy pracownik zorientuje się, że padł ofiarą ataku socjotechnicznego (np. podał hasło do firmowego VPN syntetycznemu głosowi z działu IT), kluczowy jest czas reakcji. Wymagana jest gotowa procedura Kill-Switch. Jest to zestaw instrukcji pozwalający na natychmiastowe odcięcie zainfekowanego urządzenia od sieci firmowej i zablokowanie dostępu do kont w chmurze bez czekania na zewnętrzny support.

Krok 4: Edukacja z naciskiem na AI Governance

Szkolenia w stylu „nie klikaj w dziwne linki” to przeszłość. Zespół musi wiedzieć, jak rozpoznać deepfake głosowy w firmie. Algorytmy wciąż mają problemy z nienaturalnymi pauzami na oddech, drobnymi zniekształceniami na końcówkach zdań czy powtarzaniem nielogicznych fraz przy próbie przerwania im wypowiedzi. Zrozumienie tych anomalii to podstawa nowoczesnego AI Governance.

Rekomendowane procedury: Zabezpiecz firmę od ręki

Budowanie dokumentacji i procedur od podstaw pochłania dziesiątki godzin pracy zarządu i kosztuje tysiące złotych u prawników IT. Jako przyszły Architekt Cyberbezpieczeństwa przygotowałem inżynierski system rozwiązujący ten problem od ręki.

👉 Cyfrowa Twierdza (Poradnik bezpieczeństwa dla MŚP)

- Pełny URL: https://drive.google.com/file/d/1flY8TYYidLir5Kxq_zD3DEhZUNI5GIRR/view

- Opis działania: Gotowy do wdrożenia w MŚP pakiet twardych procedur. Obejmuje kompletną „Politykę Dozwolonego Użytku AI”, checklisty onboardingowe/offboardingowe, zasady weryfikacji tożsamości chroniące przed atakami Deepfake oraz procedurę awaryjną Kill-Switch.

- Dlaczego warto: Płacisz za natychmiastowy spokój. ROI z tego wdrożenia to potencjalnie setki tysięcy złotych uratowane przed hakerami. System domyka luki w zabezpieczeniach wynikające z błędu ludzkiego, dostarczając inżynierskie procedury chroniące przed karami RODO i atakami nowej generacji.

Najczęściej zadawane pytania (FAQ)

Jak rozpoznać klonowanie głosu AI w czasie rzeczywistym?

Szukaj nienaturalnego rytmu wypowiedzi. Modele generatywne w czasie rzeczywistym mają minimalne, ułamkowe opóźnienia w odpowiedziach na niespodziewane pytania. Dobrym testem jest zadanie absurdalnego pytania niezwiązanego z tematem (np. „A jak tam pogoda dzisiaj w biurze na drugim piętrze?”) – sztuczna inteligencja często „gubi się” próbując racjonalnie zinterpretować taki zwrot akcji.

Czy weryfikacja dwuetapowa (2FA) chroni przed Deepfake 2.0?

Chroni tylko częściowo. Tradycyjne 2FA zabezpiecza dostęp do systemów, ale nie chroni przed inżynierią społeczną, w której to sam pracownik (będąc zmanipulowanym) autoryzuje operację np. poprzez aplikację bankową na polecenie fałszywego prezesa. Konieczne jest wdrożenie weryfikacji Out-of-Band.

Od czego zacząć zabezpieczanie firmy przed sztuczną inteligencją?

Pierwszym krokiem jest uświadomienie zespołu o istnieniu technologii BVC (Business Voice Compromise). Następnie należy absolutnie zakazać omijania standardowych ścieżek akceptacji kosztów (nawet w „sytuacjach kryzysowych”) i wdrożyć twardą procedurę Safewords.

Podsumowanie

Zagrożenie ze strony Deepfake 2.0 w atakach socjotechnicznych to nie pieśń przyszłości, to brutalna teraźniejszość polskiego biznesu. Poleganie na zaufaniu i tradycyjnej identyfikacji „po głosie” to zaproszenie hakerów do firmowego skarbca. Przetrwają tylko te organizacje, które zastąpią ludzką intuicję twardą, inżynierską weryfikacją.

Zabezpiecz firmę od ręki, zamknij luki proceduralne i zablokuj cyberataki – pobierz gotowe procedury: 👉 https://drive.google.com/file/d/1flY8TYYidLir5Kxq_zD3DEhZUNI5GIRR/view